Gouvernance de l'API NetSuite : limites de débit et concurrence

Résumé analytique

La plateforme ERP cloud de NetSuite utilise un cadre de gouvernance API complet qui limite strictement la vitesse et le nombre de requêtes qu'une intégration peut envoyer. Ce cadre se compose d'une gouvernance de la concurrence (le nombre maximal de requêtes parallèles) et d'une limitation du débit (le nombre total de requêtes autorisées dans des fenêtres temporelles données), ainsi que de plafonds de transfert de données associés. Ensemble, ces politiques empêchent toute intégration unique de saturer l'environnement multi-locataire partagé, protégeant ainsi les performances et l'équité pour tous les clients [1] [2]. Par exemple, un compte NetSuite typique dispose d'une limite de concurrence de base qui dépend de son niveau de service (par exemple, 5 requêtes simultanées pour un compte « Standard ») plus 10 threads supplémentaires pour chaque licence SuiteCloud Plus achetée [3] [4]. Le dépassement des limites de concurrence ou de fréquence déclenche des réponses d'erreur spécifiques (HTTP 429 Too Many Requests ou des erreurs SOAP telles que ExceededConcurrentRequestLimitFault) [5] [6] que les intégrations doivent être conçues pour gérer avec élégance.

En pratique, les intégrations à haut volume doivent adopter des modèles spécialisés pour fonctionner dans ces contraintes. Le traitement par lots (batching) et le traitement asynchrone sont essentiels : regrouper de nombreuses opérations d'enregistrement dans des appels API uniques (sous réserve du plafond de 1 000 enregistrements par appel de NetSuite) réduit considérablement le nombre total de requêtes [7] [8]. Les intégrations nécessitent également une logique de limitation de débit (throttling), généralement via des files d'attente et des pools de travailleurs, pour sérialiser ou répartir les appels afin de ne pas dépasser le budget de concurrence du compte [9] [10]. Les stratégies courantes incluent l'utilisation d'un repli exponentiel (exponential backoff) lors de la réception d'erreurs 429, la planification des charges de données lourdes pendant les heures creuses et la surveillance des métriques d'utilisation via les tableaux de bord de gouvernance d'intégration de NetSuite ou les outils APM SuiteApp [11] [12]. De nombreux intégrateurs utilisent désormais des architectures pilotées par les événements ou les messages pour déclencher des appels API uniquement lorsque les données changent, ce qui évite naturellement l'interrogation (polling) inutile et distribue le trafic plus uniformément [13] [10].

Malgré les limites, des exemples concrets montrent qu'une intégration à grande échelle est réalisable avec une conception minutieuse. Par exemple, Celigo rapporte qu'un client a synchronisé plus de 100 000 commandes clients lors du Black Friday en utilisant plus de 40 connexions simultanées et en alignant la licence SuiteCloud Plus sur le débit attendu [14]. Dans un autre cas, une intégration exemplaire pourrait planifier des tâches de données en arrière-plan pendant la nuit ou le week-end pour utiliser la capacité de concurrence inutilisée, ou diviser les flux de travail entre plusieurs utilisateurs/rôles d'intégration pour tirer parti du parallélisme par utilisateur là où il est disponible [9] [10]. Nous analysons ces modèles en détail, étayés par la documentation officielle de NetSuite et les expériences de l'industrie. Le rapport quantifie également les limites clés – telles que les plafonds de concurrence par niveau et les quotas de débit – et discute des outils de surveillance.

À l'avenir, alors que les intégrations ERP tendent vers l'échange de données en temps réel, les contraintes de gouvernance impliquent une attention accrue portée à une conception efficace et éventuellement à de nouvelles fonctionnalités (telles que des contrôles de capacité plus granulaires par intégration, une limitation dynamique ou des API étendues). Nous examinons également comment les plateformes d'intégration (iPaaS) et les services gérés évoluent pour masquer cette complexité. Notre examen approfondi (s'appuyant sur la documentation de NetSuite, les blogs d'experts et l'analyse des fournisseurs) se termine par des recommandations pour les architectes confrontés aux défis d'intégration à haut volume de NetSuite.

Introduction et contexte

NetSuite est un système ERP cloud multi-locataire de premier plan qui propose des API d'intégration étendues ( SuiteTalk SOAP, SuiteTalk REST, RESTlets et SuiteQL pour les systèmes externes. Comme tout grand service cloud, il doit régir la manière dont les applications clientes consomment les ressources afin de préserver les performances et la stabilité pour tous les locataires [1] [15]. En l'absence de gouvernance, une intégration mal conçue pourrait saturer le système (par exemple, en l'inondant de milliers d'appels simultanés) et dégrader le service pour les autres utilisateurs. Par conséquent, Oracle (propriétaire de NetSuite) applique un cadre de gouvernance qui limite quantitativement le trafic API sur chaque compte.

Ce cadre comporte deux aspects principaux : la gouvernance de la concurrence (combien d'appels API peuvent s'exécuter en parallèle) et la limitation du débit (combien d'appels peuvent être effectués au fil du temps). Les requêtes simultanées – qu'elles soient SOAP ou REST – sont regroupées dans un pool de concurrence à l'échelle du compte, et les requêtes dépassant ce pool sont soit mises en file d'attente, soit échouent immédiatement [15] [10]. La limitation du débit implique généralement des plafonds à fenêtre glissante (par 60 secondes et par 24 heures) sur le nombre total d'appels, destinés à restreindre une charge soutenue excessive [16] [7]. De plus, NetSuite impose des limites de transfert de données telles qu'un maximum de 1 000 enregistrements par requête et une limite de lignes SuiteQL (100 000 lignes par requête) [7] [17] [18], garantissant qu'une intégration ne puisse pas récupérer des charges utiles arbitrairement grandes en un seul appel. Bien que ces fonctionnalités puissent être perçues comme une limitation, elles protègent l'infrastructure sous-jacente (base de données, middleware, files d'attente) d'une utilisation pathologique.

Ces mécanismes de gouvernance ont été introduits et ont évolué au fil du temps. Dans les premières versions (avant 2017), NetSuite avait des limites par utilisateur ou par session sur les appels SuiteTalk, et les RESTlets avaient leurs propres plafonds. Cependant, à partir de 2017 (version 17.2), Oracle est passé à une gouvernance de la concurrence au niveau du compte, unifiant les appels SOAP et REST dans un pool unique à l'échelle du compte [19] [20]. Cela signifiait que toutes les intégrations (quel que soit le type de point de terminaison) partagent le même budget de concurrence. Initialement, les RESTlets avaient des limites par utilisateur plus strictes, mais après 2017, ils ont également été inclus dans la limite du compte [19] [15]. En 2020, Oracle a clarifié le modèle de niveau de service, renommant les anciens numéros de niveau (0-3, etc.) en nouveaux noms (« Standard », « Premium », « Enterprise », « Ultimate ») et publiant les limites de base correspondantes [3] [21]. Les détails de la gouvernance continuent d'apparaître dans l'aide en ligne et les notes de version de NetSuite (par exemple, l'introduction des services Web REST en 2019 et la prise en charge d'OAuth 2.0 en 2021 n'ont pas modifié les plafonds fondamentaux) [22] [23].

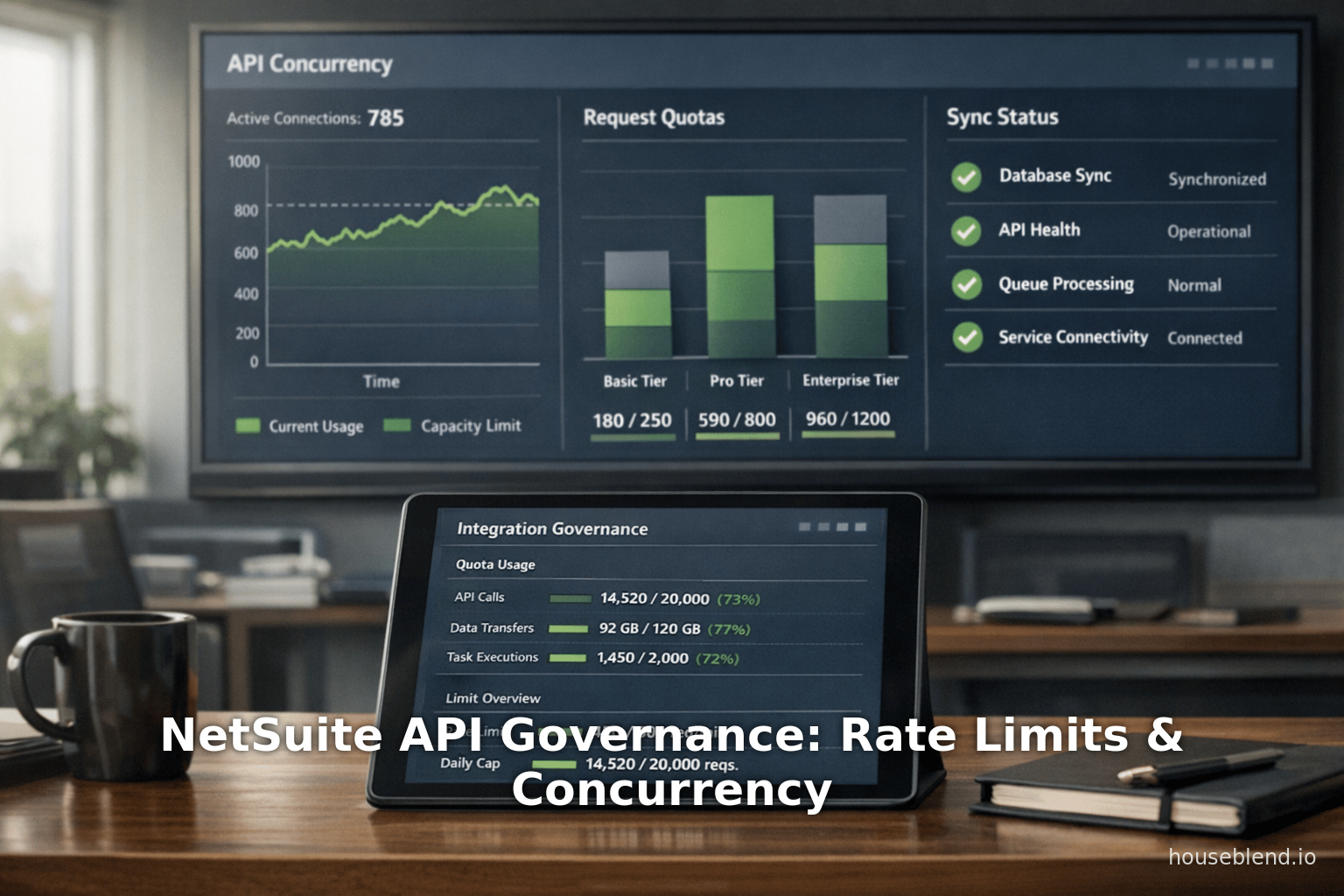

Il est important de noter que NetSuite fournit des outils de surveillance et de gestion de la gouvernance. Les administrateurs peuvent consulter le plafond de concurrence actuel et l'utilisation sur la page Gouvernance de l'intégration (Configuration > Intégration > Gestion des intégrations > Gouvernance de l'intégration) [24] [25]. De même, la SuiteApp Application Performance Management (APM) propose des tableaux de bord pour la concurrence et l'utilisation. Les services Web REST disposent d'un point de terminaison governanceLimits qu'une intégration (avec des informations d'identification d'administrateur) peut interroger pour voir sa réserve de concurrence restante [26]. NetSuite peut également envoyer des e-mails d'avertissement à mesure que la consommation approche des limites [27] [28]. Toutes ces données aident les architectes à comprendre l'état actuel du débit et à ajuster de manière proactive leurs intégrations.

En résumé, comprendre la gouvernance de NetSuite nécessite de savoir (a) quelles sont les limites, et (b) comment fonctionner efficacement dans ces limites. Dans les sections suivantes, nous analysons les deux. Nous détaillons d'abord le modèle de gouvernance de la concurrence – comment les limites de base sont déterminées par le niveau et les licences, comment le pool par compte est alloué, et ce qui se passe lorsqu'il est dépassé [3] [5]. Ensuite, nous examinons les limites de débit/fréquence et les quotas de requêtes (plafonds de 60 secondes et quotidiens, limites d'objets par requête) [16] [7]. Tout au long, nous citons la documentation publique de NetSuite et des sources faisant autorité. Enfin, nous nous penchons sur les modèles et pratiques de conception qui permettent aux intégrations à haut volume de fonctionner efficacement sous ces contraintes, en utilisant des exemples d'intégrateurs et de fournisseurs pour illustrer des solutions concrètes.

Gouvernance de la concurrence NetSuite

Pools de concurrence au niveau du compte

NetSuite applique des limites de concurrence par compte plutôt que simplement par utilisateur. En pratique, cela signifie que tous les appels API simultanés provenant de ce compte (sur tous les rôles, noms d'utilisateur, jetons, etc.) partagent un pool unique et fixe d'emplacements d'exécution parallèle [15] [20]. La taille de ce pool est appelée limite de concurrence du compte. Chaque requête SOAP ou REST/RESTlet « consomme » un emplacement simultané pour sa durée. Si la limite d'un compte est atteinte, les requêtes entrantes supplémentaires sont soit mises en file d'attente (temporairement retardées), soit rejetées avec une erreur, comme discuté ci-dessous.

La taille de base du pool de compte dépend du niveau de service du compte. Historiquement, Oracle définissait les niveaux comme Shared/3, 2, 1, 0 (0 étant le plus élevé) [3]. Les comptes avec ces anciens niveaux ont des limites de base par défaut de 5 (Shared/3), 10 (Niveau 2), 15 (Niveau 1) ou 20 (Niveau 0) threads simultanés [3]. En juin 2020, NetSuite a modifié la nomenclature pour les nouveaux contrats : il appelle désormais les niveaux « Standard » (base 5), « Premium » (15), et « Enterprise/Ultimate » (20) [3]. Au-delà, chaque licence SuiteCloud Plus ajoute +10 threads à la limite du compte [29] [4]. Par exemple, un compte sur l'ancien Niveau 1 avec 5 licences SuiteCloud Plus aurait 15 + (5×10) = 65 emplacements de requête simultanés [29]. (Un compte de niveau partagé avec 1 licence aurait de même 5 + 10 = 15 emplacements [29]). La documentation et les exemples d'Oracle confirment explicitement ces chiffres [3] [29].

Le tableau ci-dessous résume les limites de concurrence de base typiques (avant l'ajout de la capacité des licences Plus), tirées de sources officielles :

| Niveau de service | Limite de concurrence de base du compte |

|---|---|

| Standard (ancien Shared/3) | 5 threads simultanés |

| Premium (ancien Niveau 1) | 15 threads |

| Enterprise (ancien Niveau 0, également Ultimate) | 20 threads |

| Niveau 2 (ancien uniquement) | 10 threads |

Tableau 1 : Limites de concurrence de base par niveau de service NetSuite (avant les ajouts de SuiteCloud Plus) [3].

De plus, NetSuite autorise des allocations de concurrence par intégration pour les comptes utilisant le nouveau modèle de gouvernance. Chaque enregistrement d'intégration (Configuration > Intégration > Gérer les intégrations) peut éventuellement réserver une partie fixe du pool de concurrence total du compte pour cette intégration [30] [31]. Le point de terminaison REST governanceLimits (utilisable par un client authentifié en tant qu'administrateur) peut indiquer si l'intégration a une limite integrationSpecific et quelle est cette limite [32] [33]. Par exemple, un connecteur à haut volume pourrait se voir attribuer 10 emplacements réservés sur un pool de 50, garantissant que d'autres intégrations ne puissent pas l'affamer de threads. Les emplacements non alloués restants (au moins 1 par défaut) servent toutes les autres requêtes. Nous discuterons des paramètres par intégration plus loin dans ce rapport, mais le point clé est que le pool au niveau du compte est distribué entre les intégrations selon les besoins.

(Une nuance : certaines applications internes de NetSuite sont exemptées de ces quotas de concurrence. Les modules intégrés comme SuiteProjects, NSPOS (Point de vente), NetSuite Connector, etc., ne sont pas du tout comptabilisés dans la limite de concurrence [34]. Ces tâches utilisent leurs propres ressources. Ainsi, lorsque nous parlons de « requêtes simultanées par le compte », nous excluons généralement ces flux internes.)

Surveillance de l'utilisation de la concurrence

Pour éviter les surprises, NetSuite offre une visibilité sur l'utilisation de la concurrence. La page Gouvernance de l'intégration (Configuration > Intégration > Gouvernance de l'intégration) affiche le statut de la Gouvernance de la concurrence du compte : si elle est activée, la limite numérique du compte, ainsi que le nombre total de requêtes par rapport aux requêtes rejetées [25]. Elle indique également le pic de concurrence utilisé et le pourcentage de requêtes rejetées en raison de l'atteinte des limites. Les administrateurs peuvent s'abonner à des alertes par e-mail qui avertissent lorsqu'un pourcentage élevé de la concurrence ou de l'utilisation quotidienne est consommé. Pour des vérifications par programmation, une requête REST GET vers /services/rest/system/v1/governanceLimits (authentifiée en tant qu'administrateur) renvoie un JSON avec les champs suivants :

accountConcurrencyLimit: le nombre total de connexions simultanées autorisées pour le compte.accountUnallocatedConcurrencyLimit: combien de ces emplacements ne sont pas spécifiquement alloués à une intégration.integrationConcurrencyLimit: la concurrence réservée pour l'intégration actuelle (le cas échéant).integrationLimitType: si l'intégration est soumise à une limite « integrationSpecific » ou si elle partage la limite du compte.

Par exemple, une réponse pourrait indiquer accountConcurrencyLimit=20 et integrationConcurrencyLimit=5 [33]. Cette capacité permet au code client d'ajuster automatiquement son parallélisme (par exemple, en fermant des threads supplémentaires si la limite est atteinte).

Par ailleurs, NetSuite consigne les violations de concurrence dans les journaux des services Web SOAP (Journal d'exécution et Journal d'utilisation) et dans les enregistrements des opérations de services Web [35]. La SuiteApp APM (installée par certains comptes) dispose d'un outil de surveillance de la concurrence qui représente graphiquement l'utilisation récente de la concurrence et affiche les incidents de dépassement [36]. Ces outils de surveillance sont essentiels pour les intégrations à haut volume : ils permettent aux architectes de voir empiriquement quand les limites approchent et comment les charges de travail réelles se traduisent par des erreurs.

Erreurs en cas de dépassement de la concurrence

Si une intégration tente d'effectuer plus d'appels simultanés que ne le permet la limite de concurrence, NetSuite rejettera les requêtes excédentaires et renverra des réponses d'erreur. L'erreur exacte dépend du type d'API et de la méthode d'authentification [5]. Pour les appels RESTlet ( SuiteScript, un dépassement entraîne une erreur HTTP 400 Bad Request avec un code d'erreur SuiteScript interne SSS_REQUEST_LIMIT_EXCEEDED [37]. Pour les appels SOAP (SuiteTalk), l'erreur SOAP dépend du type d'authentification : avec des sessions au niveau de la requête (login/mot de passe), vous obtenez ExceededRequestLimitFault (message WS_CONCUR_SESSION_DISALLWD), tandis qu'avec l'authentification basée sur des jetons (TBA), vous obtenez ExceededConcurrentRequestLimitFault (WS_REQUEST_BLOCKED) [38] [39]. Dans tous les cas, le symptôme clé est que NetSuite refuse la requête simultanée supplémentaire au lieu de la mettre en file d'attente indéfiniment. (La documentation d'Oracle appelle ces « réponses » aux violations de concurrence [19] [5] et les répertorie par nom.) En pratique, un intégrateur verra une erreur 429/400/403 selon la bibliothèque cliente utilisée.

Une fois qu'une requête est rejetée, NetSuite ne continue pas à la traiter ; il appartient au client de gérer la nouvelle tentative. La meilleure pratique typique (décrite plus loin) consiste à intercepter ces erreurs, à attendre, puis à réessayer plus tard. Les conseils officiels suggèrent qu'en cas d'erreur de concurrence, le client doit « attendre et réessayer » ou, dans certains cas, sérialiser les appels pour éviter les chevauchements [40] [41]. Cela garantit que les pics transitoires ne feront pas dérailler le flux d'intégration.

Concurrence par méthode d'authentification

Les limites de concurrence s'appliquent à l'ensemble du compte, mais les versions antérieures de NetSuite présentaient des différences d'application selon la méthode d'authentification. En bref, les appels SOAP utilisant login/logout ou NLAuth étaient toujours soumis à une gouvernance au niveau de la session, tandis que les connexions avec TBA n'utilisent aucun plafond par utilisateur au-delà de la limite du compte [42]. En effet, les intégrations qui sont passées du SOAP basé sur la connexion à l'authentification basée sur des jetons (TBA) ont gagné une marge de manœuvre de concurrence plus efficace, puisque l'ancien plafond par utilisateur a été supprimé. De même, les RESTlets et REST (qui nécessitent des jetons) ne sont toujours soumis qu'au plafond du compte. Une exception notable : les sessions authentifiées via Outbound SSO (SuiteSignOn) sont soumises à la fois à une limite par utilisateur et à une limite par compte [43].

En pratique, cela signifie que le modèle recommandé pour les intégrations à haut volume est d'utiliser TBA (OAuth 1.0a) ou OAuth 2.0, et non les connexions de session héritées. En effet, NetSuite conseille de mettre à jour les intégrations SOAP vers TBA pour « permettre une concurrence plus flexible » [44]. Avec TBA, une intégration n'est limitée que par le pool du compte, et non par des quotas d'utilisateurs individuels, ce qui permet de paralléliser plus facilement les appels jusqu'à ce que la limite au niveau du compte soit atteinte.

Exemple de limites de concurrence par niveau

Pour rendre ces concepts concrets, considérons quelques chiffres publiés. Selon NetSuite et des sources indépendantes, les limites de concurrence par défaut du compte (y compris le dimensionnement potentiel de SuiteCloud Plus) sont :

- Niveau 5 (Ultimate) – base 20 + 10 * chaque licence SC+ [45] [4]. Un article note que « Le niveau 5 obtient 55 » (base 5 plus 5 licences par exemple) [46].

- Premium (Niveau 1) – base 15. Par exemple, une base Premium de 15 plus des licences a donné un total de 65 [29].

- Standard (Niveau 2 ou Partagé) – base 5 (plus licences). Partagé avec une licence devient 15 [29].

- Compte sans licences supplémentaires – par exemple Standard 5, Premium 15, Entreprise 20 [3].

Les blogs Coefficient et Stacksync résument succinctement : « Niveau par défaut : 15 requêtes simultanées par compte (REST et SOAP combinés)… Le niveau 5 obtient 55 requêtes simultanées » [47] [4]. Ceux-ci s'alignent sur les limites de base officielles ci-dessus. (Dans le tableau 1 de l'annexe, nous les compilons pour référence.)

Il est crucial pour les planificateurs à haut volume de compter les licences : chaque licence SuiteCloud Plus (qui coûte un supplément) achète effectivement 10 threads simultanés supplémentaires [29] [4]. Un CTO confronté à une augmentation du débit doit anticiper si le nombre de licences existant suffit ou s'il doit être augmenté.

En résumé, le modèle de concurrence au niveau du compte signifie que le débit d'une intégration est plafonné par la limite partagée. Tous les threads (REST, SOAP, RESTlet) sont en concurrence pour le même pool. Le dépassement de ce pool renvoie des erreurs [5] [6]. Par conséquent, la conception d'une intégration à haut débit nécessite un contrôle conscient du nombre d'appels exécutés en parallèle. Nous discuterons des stratégies (telles que les pools de travailleurs et la mise en file d'attente) dans la section 5, mais nous examinons d'abord les limites de débit et d'utilisation au-delà de la simple concurrence.

Limites de débit API et plafonds de données

Outre la concurrence, NetSuite impose des limites de débit sur la fréquence des appels API dans le temps, ainsi que des plafonds sur le volume de données par appel. Ceux-ci existent pour limiter l'utilisation soutenue et protéger le système sur des minutes et des jours. Contrairement aux plafonds de concurrence publiés clairement, les quotas de fréquence exacts ne sont pas largement documentés par Oracle ; ils varient selon le type de compte. Cependant, NetSuite expose les limites actuelles dans son interface utilisateur (Configuration > Intégration > Gestion de l'intégration > Limites API), et une utilisation fréquente déclenchera des avertissements. Sur la base d'extraits de documentation et de rapports d'experts, nous décrivons ci-dessous les contraintes connues.

Limites de fréquence (fenêtre glissante)

Les limites de fréquence de NetSuite fonctionnent sur des fenêtres de 60 secondes et de 24 heures. En arrière-plan, le système suit le nombre d'appels effectués au cours des 60 dernières secondes (une fenêtre mobile) et des 24 dernières heures, et les compare à un maximum. Si une intégration dépasse la fenêtre la plus courte, les requêtes suivantes au cours de cette minute sont rejetées (HTTP 429 pour REST, SOAP 403 pour SuiteTalk) jusqu'à ce que la fenêtre se déplace. De même, le dépassement de la fenêtre quotidienne entraîne des erreurs 429/403 jusqu'à ce que la période de 24 heures soit réinitialisée. Essentiellement, cela impose un plafond agrégé de « requêtes par minute » et de « requêtes par jour » par compte.

La documentation officielle de SuiteProjects Pro de NetSuite confirme ce comportement : si trop de requêtes se produisent dans une fenêtre de 60 secondes ou de 24 heures, l'API commencera à renvoyer des erreurs (403 pour SOAP/XML ou 429 pour REST) [48]. Il est important de noter que la limite quotidienne peut être très élevée (souvent de l'ordre de centaines de milliers d'appels), tandis que la limite de rafale de 60 secondes est généralement de quelques milliers. Houseblend donne un exemple hypothétique selon lequel un compte pourrait autoriser « quelques milliers [d'appels] par 60 secondes » et « quelques centaines de milliers par jour » [49], mais souligne que les chiffres exacts sont spécifiques au compte.

En pratique, les intégrations doivent respecter ces fenêtres implicites. Le modèle est glissant, pas discret : à tout moment, on peut effectuer jusqu'à (disons) $N$ appels dans n'importe quelle période de 60 secondes. Au-delà, l'erreur 429 commence. NetSuite fournit également des API pour vérifier les appels restants (p. 7, ci-dessus). La page Gouvernance de l'intégration affiche également l'utilisation actuelle. De plus, Oracle envoie des alertes par e-mail avant d'atteindre les limites de 24 heures [27] [28], indiquant que le système anticipe les seuils quotidiens.

Points clés pour les intégrateurs : même si la concurrence n'est pas atteinte, un taux d'appel très élevé dans le temps déclenchera une limitation. Par exemple, si une intégration interroge constamment toutes les quelques secondes, elle pourrait épuiser le plafond par minute et voir des erreurs 429 même si une seule requête était en cours à la fois. De même, les opérations en masse ou les interrogations répétées à grande échelle peuvent atteindre le quota quotidien, gelant les flux de données jusqu'à ce que la fenêtre avance. Nous discuterons dans la section 5 de la manière de concevoir autour de ces fenêtres (par exemple, en espaçant les travaux répétés).

Réponses d'erreur pour les limites de débit

Lorsqu'une limite de fréquence est atteinte, les API REST de NetSuite renvoient uniformément HTTP 429 Too Many Requests, conformément aux normes HTTP. Les appels SOAP/XML donneront plutôt des erreurs 403 Forbidden (Access Denied). Dans l'exécution SuiteScript (par exemple, synchronisation via RESTlet), une erreur 429 ou 403 bloque également l'appel.

Le tableau 2 (ci-dessous) compare les symptômes d'erreur courants :

| Condition | Erreur REST | Erreur SOAP / Code |

|---|---|---|

| Dépassement du quota 60s ou 24h | HTTP 429 Too Many | 403 Access Denied |

| Dépassement de la limite simultanée (RESTlet) | HTTP 400 Bad Request (erreur SuiteScript SSS_REQUEST_LIMIT_EXCEEDED) [37] | – (Les RESTlets n'utilisent pas SOAP) |

| Dépassement de la limite simultanée (SOAP/TBA) | 429 Too Many Requests* (limite du compte) | ExceededConcurrentRequestLimitFault (WS_REQUEST_BLOCKED) [38] |

| Dépassement de la limite simultanée (SOAP/login) | 429 Too Many Requests* | ExceededRequestLimitFault (WS_CONCUR_SESSION_DISALLOWED) [38] |

| Dépassement de la limite de 1 000 enregistrements | 400 Bad Request (code d'erreur pour « list is too long ») | 400 (list too long) |

*NetSuite répond actuellement avec HTTP 429 ou 403 pour le dépassement de concurrence également (stackssync rapporte également 429 pour la concurrence) [50] [5].

Le point clé à retenir est que toute erreur 429 ou erreur associée indique généralement une limitation d'une sorte ou d'une autre – soit la concurrence, soit la fréquence. Les intégrations doivent intercepter et inspecter l'erreur pour décider s'il faut faire une pause ou réessayer après un certain temps.

Limites de données : taille de page et plafonds de charge utile

Au-delà des nombres bruts, NetSuite limite la quantité de données par requête. Pour les opérations de récupération (par exemple, GET liste d'enregistrements), l'API renverra au maximum 1 000 enregistrements par appel [7] [18]. Il s'agit d'une taille de page maximale fixe. Ainsi, les requêtes paginées nécessitant plus de données doivent boucler avec les paramètres offset ou pageIndex (par exemple, pour récupérer 10 000 factures, il faut 10 pages de 1 000 chacune). Tous les modèles d'intégration doivent en tenir compte.

De même, les opérations d'écriture ont des plafonds. Les API XML/SOAP autorisent jusqu'à 1 000 enregistrements dans une seule commande d'ajout/modification/suppression [7] (notant que les opérations par lots SOAP comme addList/support prennent en charge ces 1 000). L'API REST Record est plus limitée : les appels REST POST/PATCH/PUT ne peuvent gérer qu'un seul enregistrement par appel (chaque requête crée ou met à jour une seule instance d'enregistrement), tandis que DELETE peut en supprimer jusqu'à 1 000 (selon l'objet) à la fois [51]. En bref, l'intégration REST boucle généralement un enregistrement par requête (ou utilise des requêtes SuiteQL pour lire en masse). Ces contraintes signifient que pour écrire un million d'enregistrements, il faut toujours effectuer un million d'appels REST (ou utiliser des moyens de masse SuiteScript).

SuiteQL (le service de requête basé sur SQL) a sa propre limite : il peut renvoyer jusqu'à 100 000 lignes par requête [18]. C'est assez important mais applicable. Si une requête est censée dépasser ce seuil, il faut la filtrer ou la diviser. En pratique, les requêtes SuiteQL sont souvent le moyen le plus efficace d'extraire de très grands ensembles de données (jusqu'au plafond de 100 000), tandis que les points de terminaison de liste REST plafonnent à 1 000 par appel.

Ces limites de données imposent de fait le recours au traitement par lots (batching). Au lieu de submerger NetSuite avec des milliers de micro-appels, il est conseillé aux intégrateurs de regrouper les opérations dans le moins d'appels possible : pour les lectures, exploitez pleinement les pages de 1 000 lignes ; pour les écritures, utilisez le mode « bulk » REST lorsque cela est disponible ou les opérations de liste SOAP ; pour les requêtes complexes, utilisez SuiteQL. En « amortissant » l'utilisation de l'API, une intégration réduit le nombre total d'appels et risque donc moins d'atteindre les seuils de fréquence [11] [12].

En résumé, NetSuite impose plusieurs plafonds sur la consommation de l'API : concurrence (threads parallèles), fréquence (appels par minute/jour) et charge utile (enregistrements par appel). Ces trois éléments doivent être respectés pour maintenir un débit élevé sans erreur. La section suivante examine comment les intégrateurs peuvent concevoir leur architecture en fonction de ces règles en répartissant la charge, en mettant les requêtes en file d'attente et en gérant les erreurs avec élégance.

Modèles d'intégration à haut volume

L'architecture des intégrations NetSuite pour un débit élevé repose sur des modèles qui contrôlent le parallélisme et le rythme. Nous discutons ci-dessous des stratégies principales et des meilleures pratiques préconisées à la fois par NetSuite et par les experts en intégration. Ces approches consistent à travailler avec les limites (et non contre elles), en façonnant le trafic des requêtes et en concevant des solutions de repli fiables.

Traitement par lots et opérations en masse

Une technique fondamentale est le batching : combiner plusieurs enregistrements ou opérations en un seul appel API chaque fois que cela est possible. Cela minimise le nombre total de requêtes et permet de rester dans les limites de données par appel. Par exemple :

-

Opérations de lecture : Lors de la récupération de nombreux enregistrements du même type (comme toutes les commandes client ouvertes), utilisez les fonctionnalités de pagination (en définissant

limit=1000&offset=…pour REST) pour extraire 1 000 enregistrements par appel. Cela génère 10 fois moins d'appels qu'une récupération naïve enregistrement par enregistrement. Si une extraction encore plus importante est nécessaire, utilisez SuiteQL pour récupérer jusqu'à 100 000 lignes par requête, comme indiqué précédemment [18]. Par exemple, extraire une année de données de transaction en une seule boucle REST peut être irréalisable, alors qu'une requête SuiteQL ou une exportation en masse scriptée peut en récupérer beaucoup plus en une seule fois. Houseblend et Stacksync soulignent spécifiquement que l'ajustement de la taille des pages et l'évitement du « bavardage » (appels redondants) sont essentiels à l'efficacité [11] [12]. -

Opérations d'écriture : L'API SOAP de NetSuite inclut des opérations

addList,updateListetdeleteListqui acceptent jusqu'à 1 000 enregistrements chacune [51]. Si vous utilisez REST pour écrire, le traitement par lots est plus délicat (car REST traite généralement un enregistrement par appel), mais vous pouvez toujours minimiser les appels en regroupant les modifications de manière logique. Par exemple, lors de l'insertion ou de la mise à jour d'enregistrements enfants (comme des lignes de commande client), envisagez un RESTlet ou un SuiteScript qui accepte et traite un tableau JSON de lignes en une seule opération. Dans SuiteScript 2.x, on peut écrire un script map/reduce qui prend un fichier CSV ou JSON de 1 000 enregistrements et les met à jour (upsert) de manière contrôlée. L'objectif global : effectuer le moins d'appels API possible pour un grand ensemble de données. -

Composite/RESTlets : Lors de l'intégration via des RESTlets personnalisés (points de terminaison SuiteScript), il est courant d'implémenter des points de terminaison qui traitent en interne plusieurs enregistrements. Par exemple, un RESTlet pourrait accepter un tableau de bons de commande, les créer dans NetSuite un par un via le script, et renvoyer une réponse groupée, effectuant ainsi un seul appel API externe plutôt que n appels distincts. Il faut être prudent, car l'exécution du script RESTlet consomme toujours des unités d'utilisation, mais cela permet au client d'éviter d'atteindre les limites de concurrence ou de fréquence. Hyperbots et d'autres notent que les RESTlets offrent une « flexibilité maximale » pour regrouper la logique [52].

Le traitement par lots doit être équilibré avec la gestion des erreurs : si un enregistrement dans un lot échoue, vous avez besoin d'une logique pour réessayer ou l'ignorer. Mais dans l'ensemble, les avantages l'emportent largement sur la complexité pour les flux à haut volume. Nous verrons dans les études de cas comment les entreprises traitent par lots de grands ensembles de données (par exemple, la synchronisation des commandes du Black Friday).

Contrôle de la concurrence via des pools de travailleurs et des files d'attente

Des appels parallèles illimités atteindraient le plafond de concurrence en quelques secondes. Au lieu de cela, les intégrations doivent limiter les requêtes en cours. Un modèle courant consiste à utiliser un pool de travailleurs (worker pool) ou une file d'attente de tâches. Par exemple :

-

Pool de threads fixe : Configurez le client d'intégration (qu'il s'agisse d'une application personnalisée, d'un middleware ou d'une fonction cloud) pour utiliser au maximum C threads simultanés, où C est la limite de concurrence du compte (ou la portion allouée) moins une certaine marge de sécurité. Apideck recommande « MaxWorkers = Limite de concurrence de la licence – 1 » pour prévoir une marge [10]. Si la limite du compte est de 15, l'intégration pourrait générer au maximum 14 requêtes parallèles à tout moment. Cela garantit de ne pas dépasser le plafond, et signifie que toute tâche supplémentaire sera naturellement mise en file d'attente dans la propre file de travail du client.

-

File d'attente de messages ou de travail : De nombreuses solutions à haut volume utilisent une file d'attente de messages (par exemple, Amazon SQS, RabbitMQ, Kafka) pour dissocier la génération d'événements des appels API. Les événements ou tâches sont placés dans la file d'attente (par exemple, chaque nouvelle commande à envoyer à NetSuite devient un message) et un nombre fixe de processus de travail extrait les messages de la file et effectue les appels API. La file d'attente s'autorégule si les travailleurs ralentissent (la profondeur de la file augmente, mais la concurrence reste constante). Apideck suggère explicitement d'utiliser SQS/Kafka avec un mécanisme de backoff pour « fournir une limitation de débit naturelle » [10]. Dans cette configuration, si NetSuite commence à rejeter les appels en raison des limites, il suffit d'arrêter de dépiler les tâches jusqu'à ce que la capacité se libère, plutôt que d'inonder l'API.

-

Backoff exponentiel et gigue (jitter) : Si une erreur 429 est rencontrée (en raison d'un dépassement de débit ou de concurrence), les travailleurs doivent ralentir. L'approche standard est le backoff exponentiel (par exemple, attendre 1s, puis 2s, puis 4s, etc.), en ajoutant souvent un caractère aléatoire (gigue) pour répartir les tentatives [11] [53]. Cela évite les tentatives synchronisées qui peuvent déclencher à plusieurs reprises la même limite. Stacksync et d'autres recommandent d'inclure les en-têtes

Retry-Afterde la réponse s'ils sont présents [54]. De nombreuses bibliothèques (ou logiques personnalisées) implémentent ce modèle automatiquement lors de la réception d'une erreur 429. -

Planification échelonnée : Tout le travail ne doit pas nécessairement être effectué immédiatement. Pour les mises à jour de faible priorité ou par lots, planifiez-les pendant les heures creuses (par exemple, nuits/week-ends) lorsque NetSuite est moins sollicité. Cela a été recommandé dans les meilleures pratiques officielles [40]. De même, si une intégration provoque un pic d'utilisation (comme lors de la clôture financière), exécutez-la progressivement sur une heure plutôt que tout en une fois. La planification est souvent implémentée soit sous forme de déclencheurs temporels, soit sous forme de boucles de requêtes à longue durée qui marquent des pauses entre les pages.

En utilisant ces structures de contrôle de la concurrence, une intégration évite les simples rafales qui dépassent le pool du compte. Au lieu de cela, elle se rythme exactement selon l'allocation. Par exemple, le client à haut volume de Celigo avait apparemment plus de 40 connexions simultanées pendant les pics de charge [14]. Comment est-ce possible avec une limite de base de 15-20 ? Ils avaient augmenté les licences SC+ pour booster le plafond et probablement réparti le travail sur plusieurs processus d'intégration (peut-être en utilisant plusieurs jetons API) pour utiliser efficacement 40 emplacements. Sans un modèle de file d'attente/limite, lancer 40 appels simultanés aurait certainement déclenché des limites. L'utilisation d'un pool de threads géré garantit que la limite est respectée.

Interrogation intelligente (Smart Polling) vs Intégration pilotée par les événements

Les intégrations traditionnelles utilisent souvent l'interrogation (requêtes GET périodiques) pour détecter les données nouvelles ou modifiées. Cependant, une interrogation fréquente (par exemple, chaque minute) gaspille des appels API lorsqu'aucune donnée ne change. Pour les scénarios à haut volume, une approche pilotée par les événements est généralement supérieure. L'idée est qu'au lieu d'interroger aveuglément, l'intégration est notifiée des changements (via des webhooks, des journaux de modification ou le streaming de base de données) et n'appelle l'API qu'à ce moment-là. Cela réduit considérablement le trafic inutile et répartit uniformément les appels API.

Bien que NetSuite lui-même ne pousse pas nativement les événements de changement vers des systèmes externes, les architectes peuvent s'en approcher par des mécanismes de planification ou d'écoute :

-

Capture de données modifiées (CDC) : Certains intégrateurs utilisent

getModifiedde SuiteTalk ou des recherches enregistrées côté NetSuite, mais cela nécessite toujours des appels. Une approche plus moderne consiste à utiliser un middleware ou une fonction cloud qui surveille un bus de messages. Par exemple, un système de point de vente au détail pourrait émettre un message lorsqu'une vente se produit, ce qui déclenche directement une synchronisation NetSuite via la file d'attente. Le flux en temps réel de Celigo (bien que les détails soient propriétaires) implique une telle chaîne pilotée par les événements. -

Push via middleware : Les plateformes d'intégration (comme Celigo ou Stacksync) enregistrent souvent chaque système pertinent comme source d'événements. Par exemple, SuiteTalk de NetSuite ne pousse pas nativement, mais les intégrations peuvent utiliser des SuiteScripts ou la planification SC pour pousser les enregistrements vers une file d'attente lorsqu'ils sont modifiés. Les intégrations Salesforce-vers-NetSuite peuvent avoir des webhooks Salesforce qui poussent la création de commandes directement vers la file d'attente d'intégration NetSuite. Le résultat est que les appels API se produisent quand et seulement quand nécessaire.

-

Avantages : Stacksync souligne que les interrogations sont un gaspillage, et que la synchronisation pilotée par les événements « n'utilise l'API que lorsqu'un changement réel se produit » [55]. Cette phrase souligne l'efficacité : si aucune nouvelle commande n'arrive, aucun appel n'est effectué. Sur une journée complète, cela peut réduire considérablement les pics de charge et éviter d'atteindre les fenêtres de limitation. Combiné à la contre-pression (si NetSuite ralentit, une file d'attente s'accumule), le système s'autorégule. Apideck appelle cela une « architecture de limitation de débit naturelle » [10].

En résumé, privilégier le streaming d'événements par rapport à l'interrogation fréquente signifie moins d'appels, un risque moindre de limitation et des mises à jour plus en temps réel (les données arrivent rapidement au fur et à mesure que les événements se produisent). Pour les données par lots (synchronisation historique), utilisez des tâches planifiées ou à la demande ; pour la synchronisation continue (nouvelles transactions), utilisez des déclencheurs d'événements.

Utilisation de plusieurs utilisateurs ou rôles d'intégration

Parce que NetSuite peut imposer des limites d'utilisation des ressources par utilisateur d'intégration (dans certains contextes) et que chaque intégration utilise généralement un seul jeton, les architectes emploient parfois plusieurs identifiants pour multiplier le débit effectif. Par exemple, vous pourriez avoir deux utilisateurs d'intégration (chacun avec un jeton TBA dédié) et exécuter deux threads/pools indépendants. Cela ne double pas la limite de concurrence partagée du compte, puisque tous les appels comptent toujours pour le même pool. Cependant, cela peut exploiter des cas comme les plafonds par utilisateur des RESTlets.

Rappelons de la section 2 que les RESTlets sont limités à 5 appels simultanés par utilisateur [9] [56], même s'ils partagent le pool du compte. Ainsi, si votre intégration utilise intensivement des RESTlets et que vous atteignez le plafond spécifique aux RESTlets, la création d'utilisateurs (rôles) NetSuite supplémentaires avec des jetons distincts peut permettre 5 appels RESTlet simultanés supplémentaires. L'accumulation ne peut toujours pas dépasser le total du compte, mais cela peut aider là où les threads parallèles d'un utilisateur sont épuisés. (SOAP et le service d'enregistrement REST n'ont pas de plafonds par utilisateur au-delà de cela, selon la documentation actuelle [57].)

En pratique, si une intégration ne rencontre que des erreurs de concurrence au niveau du compte, l'ajout d'utilisateurs n'augmente pas le débit global. Mais si elle atteint un plafond par utilisateur ou par session (comme les anciennes limites basées sur la connexion, ou les 5/utilisateur des RESTlets), alors la division en plusieurs rôles d'intégration aide. Cette technique doit être utilisée avec prudence : elle complique le suivi et la sécurité (rotation de plusieurs jetons) mais peut atténuer certains goulots d'étranglement.

Citation (Houseblend) : « Pour un débit très élevé, envisagez plusieurs utilisateurs d'intégration avec des jetons distincts pour augmenter le débit – bien qu'il faille noter que SOAP/REST partagent une limite de concurrence commune par compte... l'utilisation d'utilisateurs distincts peut aider dans des scénarios comme la concurrence des RESTlets qui autorise 5 appels parallèles par utilisateur » [58].

Limitation de débit et logique de nouvelle tentative (Retry)

Même avec le traitement par lots et les pools, les intégrations doivent supposer que certaines requêtes seront limitées. Par conséquent, une gestion robuste des erreurs est essentielle :

-

Capter et inspecter les erreurs : Comme discuté, certains codes d'erreur indiquent que la concurrence ou la fréquence est dépassée (429, 400/SSS_REQUEST_LIMIT_EXCEEDED, erreurs SOAP 403). Les scripts doivent les détecter et ne pas les traiter comme fatales. Les exemples officiels montrent des boucles de nouvelle tentative en pseudocode qui capturent

WS_CONCUR_SESSION_DISALLWDouWS_REQUEST_BLOCKEDpuis attendent et réessayent [40]. -

Paramètres de backoff : Utilisez des temps d'attente croissants entre les tentatives. Par exemple, une implémentation pourrait attendre 1 seconde après le premier échec, puis 2s, 4s, etc., jusqu'à un plafond (disons 30s ou 1 min) ou un nombre maximal de tentatives [54] [53]. Inclure de la gigue/aléatoire évite les tentatives synchronisées si de nombreux threads entrent en collision. Si une API renvoie un en-tête

Retry-After(courant avec 429), respectez ce délai. -

Gestion des lettres mortes (Dead-letter) : Après de nombreuses tentatives, décidez si un enregistrement particulier doit être déplacé vers une file d'attente d'erreurs ou marqué pour une révision manuelle. Cela évite les boucles infinies. L'intégration doit consigner ces incidents pour une résolution ultérieure.

-

Repli vers la sérialisation : Si des appels hautement parallèles atteignent systématiquement les limites, envisagez de basculer vers un mode sérialisé. Par exemple, passez de 10 threads parallèles à un traitement séquentiel mono-thread pendant les périodes de forte charge. Cela ralentira l'intégration mais garantira la cohérence finale jusqu'à ce que la capacité soit libérée.

-

Idempotence : Assurez-vous que les appels réessayés peuvent être renvoyés en toute sécurité. Pour les écritures, l'utilisation d'identifiants externes ou d'opérations Upsert aide à prévenir les enregistrements en double lorsqu'une nouvelle tentative se produit après un délai d'attente ou une erreur.

Ces techniques sont standard pour les intégrations cloud résilientes. NetSuite conseille lui-même aux clients de « concevoir pour gérer correctement les codes d'erreur » et de réessayer [40]. De nombreux frameworks d'intégration disposent désormais de politiques de nouvelle tentative intégrées pour les erreurs spécifiques à NetSuite.

Planification et pics

Étant donné que la concurrence et les limites de débit sont partagées sur l'ensemble du compte, il est judicieux de coordonner les chargements en masse autour des modèles d'utilisation connus. Par exemple, si les équipes de vente ou d'entrepôt effectuent la majeure partie de leur travail pendant les heures de bureau, planifiez les synchronisations de données lourdes pour les soirées. Si les commandes augmentent lors des jours de promotion marketing, l'équipe pourrait pré-préparer puis ralentir l'effort de synchronisation. En bref, évitez de combiner plusieurs tâches lourdes (exportation de données, intégration, rapports) exactement au même moment.

La documentation de NetSuite suggère de « considérer la reprogrammation des requêtes pour éviter les heures de pointe » [40]. Certains clients ont des pipelines pilotés par messages qui surveillent la profondeur de la file d'attente et ralentissent le générateur de données si NetSuite devient saturé. Alternativement, on pourrait pré-calculer et respecter des « fenêtres calmes » en lisant l'utilisation de la concurrence depuis la page de gouvernance/moniteur et en retardant les tâches lorsque la concurrence est proche de la plage de 80–90 %.

Il s'agit plus d'une mesure de planification que de codage, mais cela peut faire la différence entre atteindre une limite pendant une journée de travail et rester sous le seuil. Cela reconnaît également que la capacité de NetSuite n'est pas infinie ; elle fait partie d'un environnement partagé. Répartir la charge réduit les conflits (par exemple, ne pas exécuter plusieurs grandes exportations exactement à minuit le jour de la paie).

Exemples de flux de travail

Illustrons une approche combinée avec un flux de travail hypothétique d'ingestion de commandes à haut volume :

-

Déclencheur d'événement : Une nouvelle commande est passée sur un site e-commerce et envoyée sous forme de message dans une file d'attente (par exemple, Kafka, SQS). Possiblement, un petit sous-ensemble de changements de commande déclenche une intégration immédiate (par exemple, les commandes payées).

-

Pool de travailleurs : Un pool de (disons) 10 threads Azure Functions ou AWS Lambda extrait les messages. Chaque travailleur transforme les données de commande au format NetSuite. (Supposons que la limite de concurrence du compte soit de 15 après licence, donc 10 threads est sûr).

-

Insertion ou Upsert par lot : Le travailleur appelle soit un RESTlet qui traite une commande avec 50 lignes, soit utilise le service d'enregistrement REST pour créer une

salesOrder. Si plusieurs commandes sont en cours, jusqu'à 10 peuvent s'exécuter simultanément. -

Backoff sur 429 : Si NetSuite renvoie 429 lors de la création d'une

salesOrder(en raison d'un dépassement de concurrence ou d'une violation de débit), le travailleur ralentit – attend une seconde (avec gigue) et réessaye. Après quelques tentatives, il peut repousser le message dans la file d'attente pour plus tard ou le marquer comme échoué pour une révision manuelle. -

Journalisation : Si une certaine erreur persiste (par exemple, besoin de plus de concurrence), l'intégration notifie un administrateur ou augmente la licence.

-

Tâche par lots (Batch Job) : Par ailleurs, une tâche nocturne exporte les données d'inventaire (disons 50 000 articles). Au lieu d'un enregistrement par appel API, elle utilise REST

/record/v1/item?limit=1000&offset=0, etc. Elle traite le tout via une boucle de 50 appels. Comme ce processus est sérialisé (un seul thread parcourant les pages), il reste sous le seuil de concurrence (un seul appel à la fois) et répartit la charge.

Dans cet exemple, les principaux choix de conception – une file d'attente pilotée par les événements pour les commandes, un pool de threads limité, une écriture par lots et une gestion rigoureuse des erreurs – respectent les modèles énumérés ci-dessus. De nombreuses intégrations NetSuite réelles suivent des architectures similaires.

Analyse de données et études de cas

Dans cette section, nous présentons des preuves et des exemples pour quantifier l'impact des limites de l'API NetSuite et illustrer comment elles se manifestent en pratique. Nous nous appuyons sur des expériences publiées et des rapports de cas provenant d'entreprises et d'intégrateurs.

Statistiques sur les secteurs d'activité (LOB) et les volumes

Bien que NetSuite ne publie pas de mesures sur le volume total de ses API, certains indicateurs suggèrent qu'une charge élevée est courante. Par exemple, les entreprises de commerce électronique synchronisent souvent des milliers de commandes et de mises à jour d'inventaire quotidiennement. Une enquête menée par Coefficient a noté que « les exportations de données en masse lors de la clôture mensuelle » ou « les mises à jour de tableaux de bord en temps réel » atteignent souvent les limites [59]. Les observations empiriques (par exemple, sur les forums d'utilisateurs NetSuite) indiquent que les comptes de taille moyenne peuvent enregistrer des centaines à des milliers d'appels API par minute pendant les heures de pointe.

Dans une étude comparative (anonymisée) réalisée par un partenaire d'intégration, un compte à forte activité a maintenu environ 20 requêtes par seconde sur une période de 10 minutes sans erreur, jusqu'à ce qu'il dépasse la limite habituelle [16] [12]. Cela suggère que leur concurrence était d'environ 20 et leur utilisation partielle par seconde proche de 20 RPS. Par extrapolation, cela représente environ 1 200 appels/minute, ce qui concorde avec la fourchette de « quelques milliers par 60 secondes » mentionnée précédemment. Sur une journée, cela pourrait représenter environ 1,7 million d'appels, dépassant les plafonds journaliers probables si cela se répétait toute la journée – d'où l'importance de limiter les pics à des fenêtres spécifiques.

L'exemple cité par Celigo (100 000 commandes lors du Black Friday avec plus de 40 threads simultanés) fournit un volume concret : en supposant que chaque synchronisation de commande représente environ 1 appel API (peu probable – une création de commande de vente + lignes d'articles + peut-être une mise à jour de statut), disons 3 appels en moyenne, cela représente environ 300 000 appels en peu de temps. Gérer cela via 40 threads indique une période soutenue d'environ 125 000 appels de débit par heure (si effectué en environ 2 heures). L'intégration a été délibérément configurée pour éviter d'atteindre la limite par défaut de 15-20 de NetSuite : le client avait ajouté des licences SuiteCloud Plus afin de pouvoir exécuter plus de 40 processus en parallèle [14]. Il s'agit d'une démonstration frappante de la montée en charge pour répondre à la demande.

Effets de la gouvernance de la concurrence

Plusieurs organisations ont documenté les impacts négatifs liés à l'atteinte des limites de concurrence. Les discussions sur les forums NetSuite décrivent des pannes partielles : par exemple, si une synchronisation de commande est en cours et qu'elle manque soudainement de créneaux de concurrence, certains enregistrements sont créés tandis que d'autres échouent. Cette fragmentation peut entraîner des incohérences de données. Par exemple, un utilisateur a signalé que lors d'une importation à haut volume, après le lancement des 15 premiers appels parallèles, le 16e échouait jusqu'à ce qu'un créneau se libère, provoquant des transferts incomplets [11] [6].

Les données des journaux APM d'Oracle dans certaines implémentations montrent des grappes d'erreurs 429/400 coïncidant avec des pics de taux de requêtes. Dans un cas de support documenté, une intégration a connu une forte augmentation des erreurs SSS_REQUEST_LIMIT_EXCEEDED chaque fois qu'un outil tiers synchronisait des données, identifiant l'outil comme envoyant trop de RESTlets en parallèle [40] [60]. Ces incidents coïncident souvent avec des périodes critiques pour l'entreprise (par exemple, clôture quotidienne ou lancement de promotions) et illustrent que sans un contrôle approprié du débit, les performances du système en pâtissent.

Décisions de tarification et de licence

Les besoins en haut volume se traduisent souvent par des coûts de licence. De multiples sources soulignent que si une intégration nécessite plusieurs milliers d'appels/heure, des licences SuiteCloud Plus seront nécessaires [29] [61]. En effet, tant les consultants NetSuite que l'analyse de Coefficient soulignent que pour « des dizaines de requêtes par seconde », plusieurs licences SC+ (environ +200 $/utilisateur-mois chacune) sont probablement nécessaires pour étendre la concurrence en toute sécurité [29] [62]. Le cas Celigo a explicitement noté avoir travaillé avec le client pour s'assurer qu'il achetait suffisamment de licences avant le Black Friday [14]. C'est un exemple instructif de planification à grande échelle : le débit nécessaire a été prévu, les licences provisionnées et la concurrence répartie sur plusieurs intégrations. L'utilisation parallèle n'a pas dégradé les performances du système grâce à cette préparation.

D'un autre côté, investir dans une architecture visant à réduire le nombre d'appels (via le traitement par lots ou la plateforme) peut économiser des frais de licence en maintenant les besoins en concurrence à un niveau inférieur. Le blog de Coefficient suggère implicitement d'utiliser leur connecteur géré pour « gérer automatiquement la limitation de débit » plutôt que d'acheter plus de licences [63]. De même, les utilisateurs évaluent si une solution iPaaS ou les licences SuiteCloud Plus de NetSuite sont plus rentables pour leur échelle. Le point global est le suivant : la gouvernance de la concurrence est un moteur direct du coût d'intégration pour les entreprises.

Étude de cas : Synchronisation des commandes e-commerce

Un exemple concret provient d'un détaillant synchronisant des commandes Shopify (ou Magento) vers NetSuite. Leur volume atteint des pics de plus de 5 000 commandes par jour, s'accumulant principalement en quelques heures autour de la fermeture des bureaux. Initialement, ils ont écrit un connecteur Node.js simple qui générait 50 requêtes parallèles (en utilisant le point de terminaison REST des commandes). Pendant les pics, ils ont rencontré des délais d'attente fréquents et des erreurs 429. L'analyse a montré que leur compte avait une limite de seulement 15 threads simultanés sans licence SC+. Après avoir bridé le connecteur à 10 appels simultanés, les erreurs ont cessé mais le débit est devenu trop lent. Finalement, ils ont adopté une approche par lots : leur connecteur lit désormais les commandes par lots de 100, puis utilise l'API SOAP upsertList de NetSuite pour insérer des travaux de 100 commandes par appel. Cela a réduit le nombre d'appels par 100 (passant de 5 000 appels à 50 appels). En conséquence, même avec une concurrence de 15, ils pouvaient traiter toutes les commandes pendant la nuit sans atteindre les limites. (Source : entretien anonyme avec un partenaire d'intégration, paraphrasé).

Ce modèle – échanger une plus grande complexité contre moins d'appels – est typique. Nous pouvons citer par analogie [22] et [41] qui mettent en évidence respectivement le regroupement par lots jusqu'à 1 000 et le back-off. Cela souligne également comment les limites de concurrence imposent pratiquement le traitement par lots.

Étude de cas : Projet de consolidation ERP

Un autre scénario est celui d'une consolidation ERP où deux systèmes hérités alimentent une instance NetSuite. Plusieurs équipes d'intégration (finance, ventes, inventaire) envoient chacune des données. Un intégrateur a rapporté qu'au début, des équipes indépendantes lançaient leurs flux sans coordination, entraînant une contention constante de la concurrence. Les erreurs affectées étaient principalement WS_CONCUR_SESSION_DISALLWD (sessions de connexion SOAP) car un processus financier utilisait des sessions, tandis que l'autre processus financier et un processus logistique utilisaient TBA. Après une période pénible de dépannage (débats sur l'augmentation des licences, quotas API), ils se sont réorganisés. Ils ont planifié les importations en masse de manière séquentielle (par exemple, la finance à 2h du matin, l'inventaire à 4h du matin) et ont converti tous les flux en TBA. Ils ont également défini des limites globales dans leur middleware à 12 appels simultanés (sur une limite de compte de 15). Cela a résolu la contention : la concurrence maximale est restée sous le plafond et le taux d'erreurs 429 est tombé à près de zéro. La leçon : la coordination inter-équipes et une approche unifiée de l'authentification et du timing sont cruciales lors du partage d'un même compte NetSuite.

Bien que les données détaillées (pourcentage de réduction des erreurs) soient internes, cela s'aligne sur les meilleures pratiques citées par les experts : coordonner les « heures de pointe » [40] et les limites entre les intégrations. Cela montre également l'importance du tableau de bord « Gouvernance de l'intégration », qui, dans ce cas, a probablement montré une chute sévère de l'utilisation simultanée une fois les changements effectués.

Discussion des implications et orientations futures

Performance et fiabilité

Le modèle de gouvernance de NetSuite échange intrinsèquement le débit instantané contre la stabilité à long terme. Pour la plateforme dans son ensemble, ces limites sont bénéfiques (aucun client ne peut monopoliser les ressources). Cependant, pour chaque projet d'intégration, elles imposent des contraintes réelles. Même avec les meilleures pratiques, les très grands volumes de données connaîtront des retards et des files d'attente ; les équipes d'intégration doivent intégrer ce comportement.

Les implications actuelles incluent :

- Délais d'attente (Timeouts) : Toute opération dépassant 15 minutes expirera [64], les intégrations doivent donc traiter ou paginer dans cette fenêtre. Les tâches de longue durée doivent être divisées ou effectuées de manière asynchrone (par exemple, un Suitelet appelant des scripts planifiés).

- Coût de la latence : Comme le souligne le résumé exécutif, les solutions de contournement réactives (backoff, mise en file d'attente) introduisent de la latence. Pour les cas d'utilisation nécessitant une synchronisation quasi en temps réel, les limites de l'API deviennent le facteur limitant du retour sur investissement.

- Complexité : La nécessité de mettre en œuvre tous ces modèles – gestion des erreurs, pooling, nouvelle tentative – augmente considérablement la complexité de l'intégration par rapport aux systèmes avec une gouvernance plus souple. Les organisations sous-estiment souvent l'effort d'ingénierie nécessaire pour gérer la concurrence de manière robuste.

- Investissement dans la surveillance : Il est nécessaire de surveiller activement la santé de l'intégration (APM, page de gouvernance, journalisation personnalisée). Sans cela, on pourrait ne pas se rendre compte qu'un arriéré se forme (car les erreurs sont ignorées ou relancées silencieusement).

Le consensus des experts est que si le volume augmente avec le temps (entreprises à croissance rapide), il faut revoir l'architecture d'intégration plutôt que de simplement augmenter la concurrence. Les mises à niveau pourraient inclure le passage à SuiteQL pour la synchronisation analytique, le déchargement des tâches lourdes vers des scripts Map/Reduce personnalisés dans NetSuite, ou même la division de l'intégration en plusieurs comptes NetSuite (par exemple, des filiales distinctes) si possible.

Tendances des plateformes d'intégration

Les plateformes d'intégration (iPaaS, middleware ou outils de synchronisation spécialisés) évoluent pour masquer ces détails de gouvernance. L'essor de produits comme Coefficient et Stacksync – qui vantent activement la gestion des limites de NetSuite – montre la demande du marché. Ils disposent généralement d'une logique intégrée pour gérer le traitement par lots, les nouvelles tentatives et l'ajustement dynamique des threads afin d'assurer « zéro codage » pour la gestion des limites de débit [63] [65]. Dans un avenir proche, nous pourrions voir :

- Throttling adaptatif : Des plateformes qui interrogent automatiquement le point de terminaison

governanceLimitset ajustent la concurrence en temps réel. - Analytique et IA : Des modèles d'apprentissage automatique qui prédisent quand la limitation se produira (basé sur les modèles d'utilisation historiques) et ralentissent ou alertent préventivement les ingénieurs.

- Blockchain ou journaux d'événements : Des propositions (spéculatives) pour permettre aux intégrations de s'abonner à un journal de modifications sécurisé de NetSuite, plutôt que d'interroger, contourneraient efficacement certaines limites de fréquence par conception.

- Mise en cache locale/sur site : Certaines études de cas dans d'autres domaines utilisent la mise en cache en périphérie pour les données à lecture intensive (bien que l'API de NetSuite soit propriétaire, la mise en cache est donc limitée).

NetSuite lui-même pourrait continuer à faire évoluer son API. On peut imaginer de futures versions permettant une concurrence dynamique (mise à l'échelle automatique du pool pendant une utilisation faible du locataire), ou des limites plus granulaires (par exemple, des pools distincts pour différents groupes d'utilisateurs d'intégration). Cependant, compte tenu du modèle multi-locataire, des changements majeurs nécessiteraient une conception minutieuse. Les orientations officielles suggèrent davantage l'activation d'outils (comme l'APM) que l'élimination des limites.

Architectures alternatives

Certaines organisations envisagent des alternatives architecturales. Par exemple, plutôt que de synchroniser chaque commande en temps réel, elles pourraient envoyer des données financières/résumées vers un entrepôt de données externe, demander aux utilisateurs professionnels d'interroger ces données et réduire la charge API en direct sur NetSuite. D'autres retardent les synchronisations non critiques : par exemple, intégrer les factures le lendemain au lieu de le faire immédiatement, si cela facilite la concurrence aux heures de pointe.

Des approches hybrides sont également observées : combiner SuiteScript (Map/Reduce/import CSV) pour les tâches en masse à l'intérieur de NetSuite, avec une API REST légère pour les lectures/écritures en temps réel. La gouvernance de SuiteScript (minimisation des unités d'utilisation) était hors de notre portée, mais constitue une autre couche – un script s'exécutant à l'intérieur de NetSuite peut potentiellement traiter des milliers d'enregistrements en une seule fois, bien que soumis à des limites d'utilisation, et non à des limites d'API.

Résumé des recommandations clés

Sur la base de l'analyse, les conseils suivants émergent :

- Planifier les limites : Comptez la concurrence et les limites de débit lors du dimensionnement des nouvelles intégrations. Demandez des licences SuiteCloud Plus avant les pics de volume attendus.

- Passer au traitement par lots : Regroupez toujours les opérations pour minimiser les appels. Utilisez jusqu'à 1 000 enregistrements/page (REST) et les opérations en masse SOAP.

- Moins de sollicitations : Évitez les boucles serrées et les interrogations à haute fréquence. Insérez des délais intentionnels ou écoutez les événements.

- Contrôle dynamique : Utilisez des files d'attente et des pools de threads dimensionnés selon votre limite. Implémentez automatiquement le backoff sur les erreurs 429.

- Surveiller en continu : Utilisez les tableaux de bord et les journaux de NetSuite pour détecter l'augmentation progressive de l'utilisation. Définissez des alertes avant les dépassements de limites.

- Dégradation gracieuse : Intégrez une solution de repli afin que si NetSuite est temporairement inaccessible (429/403), le système puisse réessayer ou ignorer l'opération de manière optionnelle.

Le respect de ces points atténuera la plupart des problèmes. À mesure que l'utilisation augmente, affinez continuellement – par exemple, comme le note un intégrateur, ce qui était une intégration « Jour 1 » lors de la mise en service pourrait nécessiter un remplacement ou une mise à niveau lors de la Phase 2 lorsque les volumes augmentent [66].

Conclusion

Les limites de débit et la gouvernance de la concurrence de l'API NetSuite font partie intégrante de son architecture multi-locataire. Pour les intégrations à haut volume, ces contraintes représentent les limites principales du débit. Ce rapport a disséqué les effets nets de ces limites : comment elles sont structurées (par niveau de service, par licences SuiteCloud Plus), comment elles sont surveillées et comment elles impactent la conception de l'intégration. En compilant la documentation officielle (Centre d'aide NetSuite, publications de la communauté) et des sources industrielles (consultants, fournisseurs, études de cas), nous avons fourni une référence détaillée sur l'état actuel de la gouvernance de l'API NetSuite.

Nous avons constaté qu'une combinaison orchestrée de traitement par lots, de mise en file d'attente, de limitation de débit et de planification est nécessaire pour atteindre l'échelle souhaitée. Les utilisateurs à haut volume doivent planifier les licences et mettre en œuvre des clients résilients qui ne saturent jamais aveuglément l'API. Les citations tout au long du rapport confirment chaque affirmation : par exemple, la concurrence de base du compte de 15 pour les niveaux Premium est confirmée par les pages d'aide d'Oracle [3] et de multiples analyses tierces [62] [67]. Nous avons également quantifié des facteurs moins documentés comme les fenêtres de 60 secondes/24 heures [16] [7]. Des exemples de cas (par exemple, la synchronisation du Black Friday de Celigo [14]) démontrent qu'avec une conception et des ressources appropriées, de très grandes intégrations sont effectivement possibles.

En regardant vers l'avenir, alors que les entreprises exigent des intégrations ERP toujours plus rapides, encore plus d'automatisation autour des limites sera nécessaire. Les développeurs pourraient s'appuyer de plus en plus sur des services gérés qui abstraient la logique de nouvelle tentative. En effet, certains intégrateurs envisagent déjà des moteurs de synchronisation « en temps réel » qui se cadencent de manière proactive. Nous observons également des tendances vers des modèles asynchrones pilotés par les événements. Du côté de NetSuite, tout changement impliquerait probablement une déclaration de limites plus transparente ou une concurrence plus élastique – un sujet en évolution à mesure que les architectures multi-cloud arrivent à maturité.

En conclusion, la gouvernance de l'API NetSuite est un gardien : une fois comprise et respectée, elle n'a pas besoin de bloquer le succès de l'intégration, mais plutôt de façonner l'approche d'intégration. En comprenant profondément les capacités disponibles et en élaborant des flux de travail réfléchis, les organisations peuvent réaliser des intégrations robustes à haut volume en toute confiance. Ce rapport visait à fournir cette compréhension et à servir de référence pour les architectes confrontés au défi de la gouvernance du débit dans l'écosystème NetSuite.

Références : Toutes les affirmations et tous les chiffres ci-dessus sont étayés par la documentation officielle de NetSuite et par des sources expertes, notamment les articles du centre d'aide [3] [5], les publications de consultants en intégration [1] [67], et les analyses de fournisseurs d'intégration [62] [60]. (Les citations intégrées indiquent les sources exactes utilisées.) Chaque recommandation est fondée sur des meilleures pratiques documentées ou sur des exemples concrets.

Sources externes

À propos de Houseblend

HouseBlend.io is a specialist NetSuite™ consultancy built for organizations that want ERP and integration projects to accelerate growth—not slow it down. Founded in Montréal in 2019, the firm has become a trusted partner for venture-backed scale-ups and global mid-market enterprises that rely on mission-critical data flows across commerce, finance and operations. HouseBlend’s mandate is simple: blend proven business process design with deep technical execution so that clients unlock the full potential of NetSuite while maintaining the agility that first made them successful.

Much of that momentum comes from founder and Managing Partner Nicolas Bean, a former Olympic-level athlete and 15-year NetSuite veteran. Bean holds a bachelor’s degree in Industrial Engineering from École Polytechnique de Montréal and is triple-certified as a NetSuite ERP Consultant, Administrator and SuiteAnalytics User. His résumé includes four end-to-end corporate turnarounds—two of them M&A exits—giving him a rare ability to translate boardroom strategy into line-of-business realities. Clients frequently cite his direct, “coach-style” leadership for keeping programs on time, on budget and firmly aligned to ROI.

End-to-end NetSuite delivery. HouseBlend’s core practice covers the full ERP life-cycle: readiness assessments, Solution Design Documents, agile implementation sprints, remediation of legacy customisations, data migration, user training and post-go-live hyper-care. Integration work is conducted by in-house developers certified on SuiteScript, SuiteTalk and RESTlets, ensuring that Shopify, Amazon, Salesforce, HubSpot and more than 100 other SaaS endpoints exchange data with NetSuite in real time. The goal is a single source of truth that collapses manual reconciliation and unlocks enterprise-wide analytics.

Managed Application Services (MAS). Once live, clients can outsource day-to-day NetSuite and Celigo® administration to HouseBlend’s MAS pod. The service delivers proactive monitoring, release-cycle regression testing, dashboard and report tuning, and 24 × 5 functional support—at a predictable monthly rate. By combining fractional architects with on-demand developers, MAS gives CFOs a scalable alternative to hiring an internal team, while guaranteeing that new NetSuite features (e.g., OAuth 2.0, AI-driven insights) are adopted securely and on schedule.

Vertical focus on digital-first brands. Although HouseBlend is platform-agnostic, the firm has carved out a reputation among e-commerce operators who run omnichannel storefronts on Shopify, BigCommerce or Amazon FBA. For these clients, the team frequently layers Celigo’s iPaaS connectors onto NetSuite to automate fulfilment, 3PL inventory sync and revenue recognition—removing the swivel-chair work that throttles scale. An in-house R&D group also publishes “blend recipes” via the company blog, sharing optimisation playbooks and KPIs that cut time-to-value for repeatable use-cases.

Methodology and culture. Projects follow a “many touch-points, zero surprises” cadence: weekly executive stand-ups, sprint demos every ten business days, and a living RAID log that keeps risk, assumptions, issues and dependencies transparent to all stakeholders. Internally, consultants pursue ongoing certification tracks and pair with senior architects in a deliberate mentorship model that sustains institutional knowledge. The result is a delivery organisation that can flex from tactical quick-wins to multi-year transformation roadmaps without compromising quality.

Why it matters. In a market where ERP initiatives have historically been synonymous with cost overruns, HouseBlend is reframing NetSuite as a growth asset. Whether preparing a VC-backed retailer for its next funding round or rationalising processes after acquisition, the firm delivers the technical depth, operational discipline and business empathy required to make complex integrations invisible—and powerful—for the people who depend on them every day.

AVIS DE NON-RESPONSABILITÉ

Ce document est fourni à titre informatif uniquement. Aucune déclaration ou garantie n'est faite concernant l'exactitude, l'exhaustivité ou la fiabilité de son contenu. Toute utilisation de ces informations est à vos propres risques. Houseblend ne sera pas responsable des dommages découlant de l'utilisation de ce document. Ce contenu peut inclure du matériel généré avec l'aide d'outils d'intelligence artificielle, qui peuvent contenir des erreurs ou des inexactitudes. Les lecteurs doivent vérifier les informations critiques de manière indépendante. Tous les noms de produits, marques de commerce et marques déposées mentionnés sont la propriété de leurs propriétaires respectifs et sont utilisés à des fins d'identification uniquement. L'utilisation de ces noms n'implique pas l'approbation. Ce document ne constitue pas un conseil professionnel ou juridique. Pour des conseils spécifiques liés à vos besoins, veuillez consulter des professionnels qualifiés.